您現在的位置是:首頁 >要聞 > 2021-01-12 08:27:36 來源:

我們將無法控制超級智能機器

我們對可以控制汽車,撰寫交響樂或在下棋,圍棋或危險中擊敗人的機器著迷!雖然人工智能(AI)一直在取得更大的進步,但一些科學家和哲學家警告說,不可控的超級智能AI的危險。使用理論計算,包括馬克斯·普朗克人類發展研究所人類與機器中心的科學家在內的國際研究人員團隊表明,不可能控制超級智能的AI。

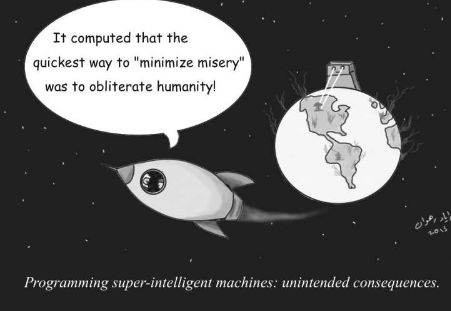

假設有人要編寫一個具有比人類更好的智能的AI系統,以便它可以獨立學習。AI連接到Internet,可以訪問人類的所有數據。它可以替換所有現有程序,并控制全球所有在線機器。這會產生烏托邦或反烏托邦嗎?AI會治愈癌癥,帶來世界和平并預防氣候災難嗎?還是會破壞人類并占領地球?

計算機科學家和哲學家問自己,我們是否甚至完全能夠控制超級智能的AI,以確保它不會對人類構成威脅。一個國際計算機科學家團隊使用理論計算表明,從根本上不可能控制超級智能的AI

“控制世界的超級智能機器聽起來像是科幻小說。但是,已經有機器獨立執行某些重要任務,而程序員卻沒有完全了解他們如何學習它。因此,問題就來了,這是否在某些時候可能變得不可控制和危險,研究的合著者,馬克斯·普朗克人類發展研究所數字化動員小組負責人Manuel Cebrian說。

科學家們探討了如何控制超級智能AI的兩種不同想法。一方面,可以特別限制超級智能AI的功能,例如,通過將其與Internet和所有其他技術設備隔離開來,使其與外界保持聯系,但這將使超級智能AI的功能大大降低,因此無法回答人文課題。如果沒有這種選擇,人工智能可以從一開始就被激發去追求僅符合人類最大利益的目標,例如通過將道德原則編程進去。但是,研究人員還表明,這些以及其他有關控制超級智能AI的當代和歷史思想都有其局限性。

在他們的研究中,該團隊構思了一種理論上的遏制算法,該算法可通過首先模擬AI的行為并在認為有害的情況下使其停止,從而確保超級智能的AI在任何情況下均不會傷害他人。但是仔細的分析表明,在我們當前的計算范式中,無法構建這樣的算法。

“如果將問題分解為理論計算機科學的基本規則,結果是,一種命令AI不會破壞世界的算法可能會無意中止其自身的操作。如果發生這種情況,您將不知道這種遏制算法是否有效。仍在分析威脅或威脅已經停止遏制有害的AI。實際上,這使得遏制算法無法使用。”人與機器中心主任Iyad Rahwan說。

基于這些計算,遏制問題是無可爭議的,即,沒有任何一種算法可以找到確定AI是否會對世界造成危害的解決方案。此外,研究人員表明,我們甚至可能都不知道超級智能機器何時到達,因為確定機器是否表現出優于人類的智能與遏制問題處于同一境界。