您現在的位置是:首頁 >要聞 > 2020-12-07 16:01:33 來源:

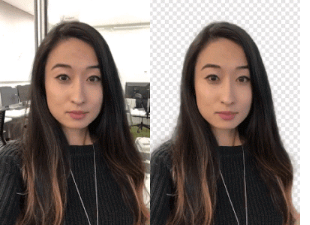

宣布適用于手機的背景交換技術

視頻創作者:想交換背景嗎?自己敲門。Google研究人員一直在研究一種方法,讓您可以使用神經網絡交換視頻背景-無需綠屏。它的滾動出來的YouTube故事移動以有限的方式,說TechCrunch的。Android Headlines的John Anon表示,YouTube創作者可以更改背景以創建更具吸引力的視頻。

Google Research的軟件工程師Valentin Bazarevsky和Andrei Tkachenka宣布了這一消息,標題為“移動實時視頻分段”。

視頻內容創建者知道,可以將場景的背景與被視為兩個不同層的背景分開。進行此操作是為了獲得心情,或者插入一個有趣的位置或增強消息的影響力。

谷歌研究網站上的兩者說,這項操作“是一項耗時的手動過程(例如,藝術家對每一幀進行旋轉攝影),或者需要一個帶有綠屏的工作室環境來進行實時背景去除(這種技術稱為色度技術)。鍵控”。

翻譯:《數字趨勢》雜志的希拉里·格里戈尼斯(Hillary Grigonis)說:“替換視頻背景通常需要使用先進的桌面軟件和大量的空閑時間,或者是配備綠色屏幕的成熟工作室。”

現在,兩者宣布了一項新技術,它將在手機上運行。

他們的技術將使創作者無需專門的設備即可替換和修改背景。

他們稱這是YouTube專門為YouTube創作者設計的新型輕量級視頻格式。

他們在3月1日發布了“通過將這項技術集成到故事中,對YouTube應用進行精確,實時的設備上移動視頻細分”的公告。

他們是如何做到的?阿農說:“這一切的關鍵在于機器學習。”

Bazarevsky和Tkachenka說,他們利用“機器學習使用卷積神經網絡解決語義分割任務”。

翻譯:“谷歌正在開發一種可以通過智能手機攝像頭實時工作的人工智能替代品,”格里戈尼斯寫道。

兩位工程師描述了適用于手機的架構和培訓過程。他們牢記“移動解決方案應該是輕量級的,并且其運行速度應比現有的最新照片分割模型至少快10-30倍”。

至于數據集,它們“注釋了成千上萬張圖像”。這些捕獲了各種各樣的前景姿勢和背景設置。

Grigonis說:“利用該數據集,該小組訓練了該程序以將背景與前景分開。”

TechCrunch的Devin Coldewey表示:“網絡學會了選擇頭部和肩膀的共同特征,并且進行了一系列優化,降低了處理數據所需的數據量。”

Digital Trends解釋了它的工作原理:“一旦軟件在第一張圖像上遮蔽了背景,程序就會使用相同的遮罩來預測下一幀的背景。當下一幀與第一幀相比只有很小的調整時...程序將對遮罩進行少量調整。當下一幀與上一幀有很大不同時...軟件將完全放棄該遮罩預測并創建一個新的遮罩。”

正如他們在Google Research博客上所說的那樣,他們工作的最終結果是“我們的網絡在移動設備上的運行速度非常快,在iPhone 7上達到了100+ FPS,在Pixel 2上達到了40+ FPS(實現了94.8%的IOU我們的驗證數據集),在YouTube故事中提供了各種流暢運行和自適應效果。”

下一步是什么?

它是限量版。“我們的近期目標是利用YouTube故事中有限的推出來測試我們在第一組效果上的技術。隨著我們將細分技術改進和擴展到更多標簽,我們計劃將其集成到Google的更廣泛的增強現實服務中。”