您現在的位置是:首頁 >要聞 > 2020-11-24 17:16:20 來源:

深度神經網絡以對抗3D徽標進行目標檢測

導讀 在過去的十年中,研究人員已經開發了越來越多的深度神經網絡,可以對其進行訓練以完成各種任務,包括識別圖像中的人或物體。盡管這些計算技

在過去的十年中,研究人員已經開發了越來越多的深度神經網絡,可以對其進行訓練以完成各種任務,包括識別圖像中的人或物體。盡管這些計算技術中的許多已經取得了顯著成果,但有時可能會誤將其誤分類為數據。

對抗性攻擊是一種專門針對深度神經網絡的網絡攻擊,誘使它們對數據進行錯誤分類。它通過創建與深度神經網絡通常分析的數據非常相似但又不同的對抗數據,促使網絡做出錯誤的預測,無法識別真實數據與對抗數據之間的細微差別來實現此目的。

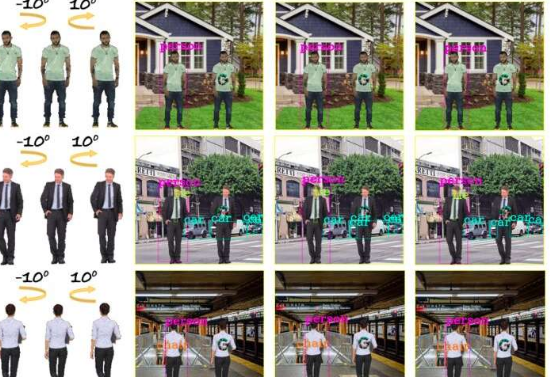

近年來,這種攻擊變得越來越普遍,突顯了許多深度神經網絡的漏洞和缺陷。近年來出現的一種特定類型的對抗攻擊需要在圖像上添加對抗補丁(例如徽標)。到目前為止,這種攻擊主要針對目標模型,這些模型經過訓練可以檢測二維圖像中的物體或人物。

德克薩斯A&M大學,德克薩斯大學奧斯汀分校,中國科學技術大學的研究人員以及MIT-IBM Watson AI Lab最近推出了一種新攻擊,該攻擊需要在圖像上添加3-D對抗性徽標,目的是:欺騙用于對象檢測的深度神經網絡。這種攻擊是在arXiv上預先發表的一篇論文中提出的,它可能更適用于現實情況,因為深度神經網絡處理的大多數真實數據都是3-D的。

“這項工作的主要目的是生成任意形狀的結構化補丁(我們稱為“徽標”),稱為3-D對抗性徽標,將其附加到3-D人體網格物體上,然后渲染為二維圖像可以始終以不同的人體姿勢欺騙對象檢測器。”研究人員在論文中寫道。

本質上,研究人員根據預先存在的2D紋理圖像創建了任意形狀的徽標。隨后,他們使用稱為徽標轉換的紋理映射方法將此圖像映射到3-D對抗徽標上。他們制作的3-D對抗性徽標可以用作對抗性紋理,使攻擊者可以輕松操縱其形狀和位置。