您現在的位置是:首頁 >綜合 > 2020-11-05 11:19:15 來源:

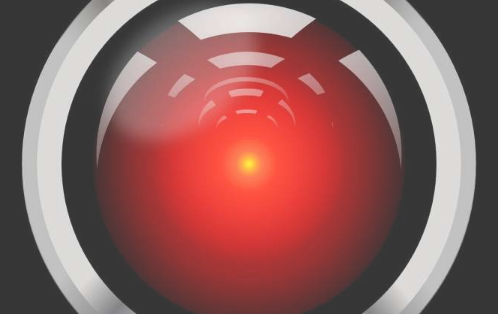

計算機科學家研究可解釋的機器學習開發AI來解釋其發現

導讀 人工智能可以幫助科學家做出發現,但并不是每個人都能理解它是如何得出結論的。一位UMaine計算機科學家正在開發深度神經網絡,以用戶理解的

人工智能可以幫助科學家做出發現,但并不是每個人都能理解它是如何得出結論的。一位UMaine計算機科學家正在開發深度神經網絡,以用戶理解的方式解釋其發現,并將其工作應用于生物學,醫學和其他領域。

可解釋的機器學習或為所到達的結果創建解釋的AI,定義了陳超凡的研究重點。計算機科學助理教授表示,可解釋的機器學習還使AI能夠在圖像和來自數據的預測之間進行比較,同時詳細說明其推理。

科學家可以將可解釋的機器學習用于各種應用程序,從識別圖像以進行野生動物調查的鳥類到分析乳房X線照片。

“我想增強深度學習的透明度,并且希望深度神經網絡能夠解釋為什么某種東西是它認為的樣子,” Chen說。“很多人已經開始意識到,深層神經網絡就像一個黑匣子,人們需要開始尋找打開黑匣子的方法。”

Chen在杜克大學(Duke University)學習期間開始開發可解釋的機器學習技術,他于五月在該大學獲得了計算機科學博士學位。

在加入UMaine之前,Chen和杜克大學的研究同事開發了機器學習架構,稱為原型零件網絡(ProtoPNet),可以對照片中的鳥類進行精確定位和分類,然后解釋其發現。團隊去年完成的ProtoPNet將解釋為什么它識別的鳥是鳥,以及為什么它代表特定類型的鳥。

研究人員訓練了ProtoPNet來確定照片中的鳥是哪種。例如,AI將學習一組表征每種鳥類的原型特征,并將鳥類圖像的不同部分與來自多種鳥類的原型特征進行比較。例如,ProtoPNet會將圖像中認為是鳥的頭部與來自各種鳥類類別的原型鳥的頭部進行比較。Chen說,利用與鳥類原型特征的相似性,ProtoPNet可以解釋為什么圖像是一種特殊的鳥類。

該小組在去年加拿大溫哥華舉行的第33屆神經信息處理系統會議上發表的一篇論文中分享了其發現。

![峰值[地面]位移(關于峰值[地面]位移簡介) 峰值[地面]位移(關于峰值[地面]位移簡介)](http://www.138071.com/uploadfile/2023/0519/thumb_100_100_9c6242d266dc9a6c93748f36886890dc254_t.jpg)